Chez Eulidia, nous accompagnons des organisations qui passent de l’expérimentation à l’industrialisation de l’IA. Et le constat est constant. En 2026, la sécurité de l’IA n’est plus un sujet technique que l’on traite en bout de chaîne. Elle devient un enjeu de gouvernance au niveau de la direction : qui décide, qui contrôle et surtout comment prouver ce qui a été fait. Dès lors que l’IA est déployée à l’échelle, la priorité n’est plus uniquement la performance des modèles, mais la gouvernance, suivie de très près par l’auditabilité de l’IA. C’est là que se jouent la conformité réglementaire, la confiance des parties prenantes et la continuité d’activité.

Sur le terrain, le constat est clair. Les organisations qui industrialisent vite sont aussi celles qui cadrent tôt. À l’inverse, les projets qui avancent sans cadre finissent presque toujours par se heurter à des blocages tardifs, coûteux et souvent évitables.

En pratique, en 2026, dans des contextes industriels et réglementés, un système d’IA crédible est un système gouverné, journalisé, testable et réversible. Tout le reste relève du prototype. Et un prototype non maîtrisé finit toujours par exposer une faille : un usage non prévu, une donnée sensible mal protégée ou une « bonne idée » lancée sans garde-fou. L’IA peut accélérer les équipes, certes, mais elle accélère aussi les incidents quand elle n’est pas encadrée.

Gouvernance de l’IA en entreprise : qui décide, qui rend des comptes, qui signe ?

La Gouvernance de l’IA en entreprise commence par une question volontairement simple : qui porte le risque lorsqu’un modèle se trompe, lorsqu’une donnée sensible est exposée ou lorsqu’un utilisateur contourne les règles ? Tant que cette responsabilité reste floue, l’organisation crée un angle mort. En 2026, ce flou a un coût immédiat, en temps, en réputation et en contrôles de dernière minute.

Le réflexe qui fonctionne consiste à partir des cas d’usage, et non des outils. Les systèmes sont inventoriés, leur criticité qualifiée, puis un niveau d’exigence est appliqué. La logique est proche d’une approche produit : chaque application d’IA dispose d’un sponsor métier, d’un owner technique et d’un responsable conformité. La documentation devient alors un actif à part entière : objectifs, périmètre, données utilisées, limites connues et scénarios de repli sont formalisés.

Comment structurer la gouvernance sans bloquer les équipes ?

Dans la durée, les grandes organisations convergent vers un schéma volontairement sobre. Un comité IA pour les décisions structurantes, un centre d’expertise pour les frameworks et l’outillage, et des équipes produit responsables de l’exécution. Cette organisation évite deux écueils fréquents : la gouvernance théorique qui ne touche jamais la production, et l’anarchie où chacun connecte une API d’IA générative à des bases de données sans contrôle.

Un test simple permet d’évaluer la maturité réelle : si l’identification des systèmes d’IA en production prend plus d’une semaine, la gouvernance de l’IA n’existe pas encore. Elle reste implicite, donc fragile. Plus l’IA se diffuse dans l’organisation, plus le risque devient systémique. Une seule chaîne mal maîtrisée peut suffire à exposer des données personnelles ou à déclencher une fuite majeure.

Où démarrer ? : de la data stratégie aux règles d’usage

Une gouvernance qui tient dans la durée ne commence presque jamais par un règlement de quarante pages. Elle démarre par quelque chose de beaucoup plus opérationnel : un inventaire clair, suivi de règles d’usage immédiatement applicables. C’est précisément la logique d’une data stratégie orientée cas d’usage. Avant de parler d’outils ou de modèles, on clarifie ce qui crée de la valeur, ce qui reste acceptable et ce qui doit être explicitement interdit.

Cette approche permet d’ancrer la gouvernance dans le réel. Les équipes savent ce qu’elles peuvent faire, jusqu’où elles peuvent aller et dans quels cas elles doivent s’arrêter. La règle n’est plus un frein abstrait, mais un cadre lisible qui sécurise les décisions et accélère les projets.

Un principe doit alors guider l’ensemble du dispositif : plus un système est critique, plus il doit être contrôlable. Pouvoir stopper un modèle, le dégrader ou le basculer en lecture seule n’est pas un luxe technique. C’est une exigence de gouvernance. Le “kill switch” agit comme une assurance. Et en matière de sécurité de l’IA, les assurances coûtent toujours moins cher lorsqu’elles sont prévues avant l’incident.

Gouvernance de la sécurité de l’IA : de la conformité à la résilience

La sécurité « classique » ne suffit plus. L’IA introduit de nouveaux vecteurs d’attaque qui ne se limitent ni au réseau ni à l’infrastructure. La gouvernance de la sécurité de l’IA doit désormais couvrir les identités, les secrets et les accès, mais aussi les prompts, les outputs de modèles, les données d’entraînement, les dépendances et les chaînes d’outils. C’est précisément sur ces zones grises que les attaquants innovent. Ils ne s’attaquent plus seulement aux systèmes, ils manipulent les comportements.

Prenons un exemple très concret. Un assistant interne est connecté à des documents RH. Un utilisateur colle un prompt piégé ou un document contenant une instruction dissimulée. Le système peut alors « obéir » et révéler des informations sensibles. Ce type de scénario est largement documenté dans les risques liés aux LLM : injection de prompt, divulgation d’informations, vulnérabilités de la supply chain. L’OWASP publie d’ailleurs un Top 10 spécifiquement dédié aux applications LLM. Ces risques ne sont plus théoriques. Ils sont déjà observés en production.

Les menaces à anticiper en 2026 (et celles déjà visibles)

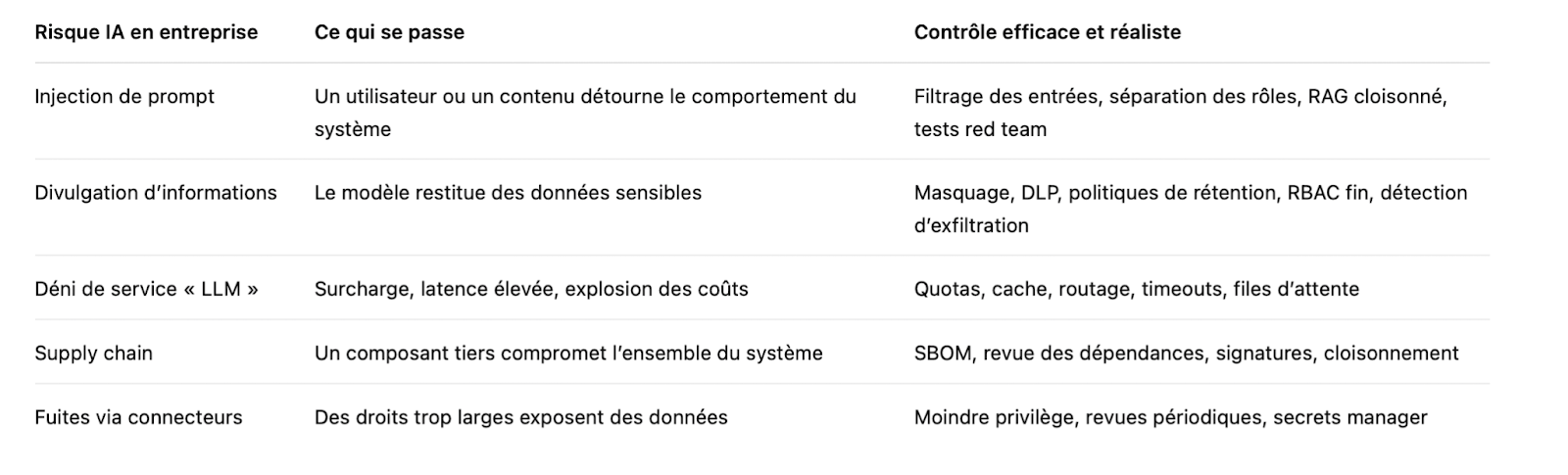

En pratique, on retrouve des familles d’attaques récurrentes. L’injection de prompt reste la plus connue, mais elle est loin d’être la seule. L’exfiltration de données, le déni de servicevia des requêtes coûteuses ou lentes, et l’empoisonnement des données sont déjà bien réels.

Oui, l’empoisonnement existe : moins fréquent que l’injection de prompt, mais à fort impact, notamment lorsque les pipelines consomment des sources non maîtrisées.

Ces vulnérabilités sont hybrides. Elles concernent à la fois la data et les modèles, pas uniquement le réseau. Un repère simple permet d’évaluer le niveau de maturité : si une équipe sait renforcer la sécurité d’un cluster Kubernetes mais ne sait pas contrôler l’output d’un modèle, un trou de sécurité subsiste. Et si tout est journalisé sauf les prompts et les décisions, l’audit devient rapidement impossible.

Risques typiques et contrôles qui fonctionnent réellement

Ce n’est pas spectaculaire, mais ce sont ces contrôles qui renforcent la sécurité sans bloquer les équipes. Ils permettent surtout d’éviter le réflexe dangereux du « on verra plus tard ». En 2026, ce « plus tard » se transforme très vite en incident.

Cloud, on premise, hybride : mêmes enjeux, contrôles différents

De nombreuses organisations industrialisent leurs usages d’IA sur des architectures cloud. C’est une approche pertinente, à condition d’aligner sécurité, coûts et exploitation. Un socle cloud bien maîtrisé facilite le chiffrement des données, la gestion des identités, la journalisation et la segmentation, tout en maintenant des performances stables.

Mais il faut éviter une illusion fréquente. Le cloud ne sécurise pas l’IA par défaut. Il fournit des outils. La responsabilité reste côté organisation : sécuriser les connecteurs, contrôler les outputs, limiter les permissions et gouverner les jeux de données. Il faut aussi prévenir les boucles d’agents, en particulier dans des architectures multi-agents ou fortement automatisées, qui peuvent consommer des volumes importants de données et de tokens sans contrôle.

Aligner AI Act, ISO et Framework NIST sans créer une usine à gaz

En 2026, la pression réglementaire devient concrète. L’AI Act de l’Union européenne est entré en vigueur le 1ᵉʳ août 2024 et devient pleinement applicable le 2 août 2026. Plusieurs jalons s’appliquent toutefois plus tôt, avec des interdictions et des obligations de littératie IA dès février 2025, puis des obligations spécifiques aux modèles GPAI à partir d’août 2025.

Le message est clair. Même si vous ne développez pas vos propres modèles, vous devrez prouver que vos usages d’IA sont maîtrisés. L’absence de développement interne ne dispense ni de la responsabilité ni de la démonstration de contrôle.

S’appuyer sur des cadres reconnus plutôt que réinventer

Le bon réflexe consiste à cartographier les pratiques existantes sur des cadres reconnus, plutôt que de créer un référentiel maison difficilement défendable. Dans les grandes organisations, trois références structurantes reviennent régulièrement.

- NIST AI RMF 1.0 : un framework orienté gestion des risques, articulé autour de quatre verbes clés. Gouverner, cartographier, mesurer et gérer les risques liés à l’IA (NIST Technical Series Publications).

- ISO/IEC 42001 : un système de management de l’IA, souvent utilisé pour structurer la gouvernance, les responsabilités et l’amélioration continue (ISO).

- ISO/IEC 23894 : des lignes directrices dédiées à la gestion des risques liés à l’IA sur l’ensemble du cycle de vie des systèmes (ISO).

À ces référentiels s’ajoutent des briques de cybersécurité plus transverses, comme NIS2 au niveau européen, ainsi que des guides spécialisés, notamment ceux publiés par l’ENISA sur les bonnes pratiques de cybersécurité appliquées à l’IA.

Le point clé : prouver le contrôle, pas seulement l’intention

Dans un audit réel, personne ne vous demande si vos intentions sont bonnes. Ce qui compte, ce sont les preuves. Politiques formalisées, décisions documentées, journaux d’exécution, tests, incidents déclarés et plans de remédiation. C’est précisément pour cela que l’auditabilité de l’IA devient un pilier central de la gouvernance de la sécurité de l’IA.

Il faut aussi accepter une réalité souvent sous-estimée. La conformité a un coût. Pas nécessairement en licences, mais en organisation, en outillage et en exploitation. Le coût le plus élevé reste humain. Lorsque personne ne sait qui décide, tout le monde ralentit. À l’inverse, une gouvernance claire accélère les projets, sécurise les décisions et réduit la friction lors des contrôles.

Produire des preuves, pas seulement des rapports

En 2026, l’auditabilité de l’IA ne se résume plus à produire des documents a posteriori. Elle correspond à une capacité très concrète : reconstituer une décision avec un niveau de précision suffisant. Quel prompt a été utilisé ? Quelle version du modèle ? Quelles sources RAG ont été sollicitées ? Quel utilisateur est à l’origine de la requête ? Quelles règles ont été appliquées et quelle action finale a été exécutée, par quel système ?

Cette approche répond directement aux exigences de documentation et de traçabilité attendues pour les systèmes à risque élevé. Elle s’aligne également avec les attentes liées aux GPAI en matière de transparence, de sécurité et de documentation, telles qu’encouragées par le Code de pratique européen publié en juillet 2025. L’objectif n’est pas la perfection théorique, mais une reconstitution fiable et exploitable.

Les logs utiles et ceux qui noient tout

Sur le terrain, on observe souvent deux excès. Soit les systèmes ne journalisent pas suffisamment, soit ils produisent un volume de logs impossible à exploiter. Dans les deux cas, l’audit devient inefficace. L’enjeu n’est pas de tout enregistrer, mais de loguer ce qui permet de détecter les dérives : dérive de performance, dérive de coûts, dérive des données et comportements suspects.

Dans un système d’IA moderne, les journaux réellement utiles incluent les identités, les prompts avec masquage, les sources consultées, les règles de filtrage appliquées, les scores de confiance et l’action déclenchée. Sans ces éléments, il devient impossible d’analyser un incident, de comprendre une décision ou de démontrer une protection des données cohérente. L’auditabilité reste alors théorique.

Données, qualité et conformité : l’audit commence avant le modèle

Une part significative des problèmes d’audit provient des données. Le modèle ne fait que refléter l’état des pipelines qui l’alimentent. Si l’origine des données est mal connue, si les droits d’accès sont flous ou si les transformations ne sont pas tracées, l’audit échoue avant même de parler d’IA.

C’est là qu’une transformation data structurée devient un facteur clé. Catalogage, lineage, contrôle de la qualité, règles d’accès et contrats de données constituent la base de l’auditabilité d’un système d’IA. Même dans des architectures d’IA générative, le RAG dépend entièrement de cette fondation. Et dès que des données sensibles ou personnelles sont en jeu, le niveau de preuve attendu augmente mécaniquement.

L’auditabilité d’un système d’IA : une check-list opérationnelle pour 2026

On peut débattre longtemps de principes, mais en 2026 les décideurs attendent surtout un plan clair. L’objectif n’est pas de produire une conformité de façade, mais de sécuriser les usages tout en continuant à livrer. Cette check-list a été pensée pour des équipes qui veulent avancer sans jouer à la roulette russe avec les risques, la cybersécurité et l’auditabilité.

La check-list essentielle

- Inventorier les systèmes d’IA et leurs dépendances

Identifier les modèles, connecteurs, bases de données, services tiers et chaînes d’outils associés. - Classer chaque système par niveau de risque

Évaluer la criticité, l’exposition et les impacts potentiels métier, légaux et réputationnels. - Clarifier les responsabilités

Définir un owner, un sponsor métier et un RACI explicite pour chaque produit d’IA. - Mettre en place des garde-fous techniques

Appliquer RBAC, principe du moindre privilège, gestion des secrets et segmentation réseau. - Contrôler les entrées et les sorties

Filtrage des prompts, DLP, politiques anti divulgation et mécanismes de safe completions. - Tester les scénarios réels

Simuler des injections de prompt, des tentatives d’exfiltration, des contournements et des escalades d’agents. - Journaliser pour l’audit

Tracer les versions de modèles, les prompts masqués, les sources RAG, les décisions prises et les actions exécutées. - Surveiller les signaux faibles et forts

Coûts, latence, dérive de la qualité, comportements anormaux et alertes opérationnelles. - Prévoir un plan de secours

Définir les mécanismes de dégradation, d’arrêt, de reprise et de communication en cas d’incident. - Revoir régulièrement le dispositif

Examiner chaque trimestre les droits, les journaux, les incidents et l’efficacité des contrôles.

Cette liste peut sembler évidente. Pourtant, dans la pratique, beaucoup d’organisations sautent les étapes les plus structurantes, notamment l’inventaire initial et la journalisation. Le résultat est prévisible. Les usages deviennent difficiles à sécuriser, l’audit devient impraticable et, lorsqu’un incident survient, personne n’est capable de répondre à une question pourtant simple : quel modèle répondait hier, et sur quelles données.

Un mot sur l’exploitation : délivrer, puis tenir la route

L’auditabilité de l’IA ne vaut rien si le produit n’est pas stable. Industrialiser un usage d’IA, ce n’est pas seulement réussir un déploiement. C’est garantir dans la durée un niveau de service, des SLA clairs et une qualité maîtrisée. C’est précisément le sens de la production de valeur : concevoir, construire, déployer, puis fiabiliser en production

Ce point n’est pas accessoire. Il constitue le cœur même de la crédibilité d’un produit d’IA en environnement industriel.

Dans la pratique, les équipes gagnent en efficacité lorsqu’elles standardisent. Gabarits de documentation, pipelines de tests, revues de sécurité et outillage LLMOps permettent de réduire les exceptions et de sécuriser les déploiements. En limitant les bricolages locaux, on réduit mécaniquement les failles et on renforce la capacité à maintenir les systèmes dans le temps, sans sacrifier la vitesse de livraison.

Conclusion : en 2026, la sécurité de l’IA, c’est une capacité de preuve

S’il ne fallait retenir qu’une idée, ce serait celle-ci : en 2026, la sécurité de l’IA se mesure à la capacité d’une organisation à prouver ce que fait un système, et à corriger rapidement lorsqu’il dévie. Le cadre européen se précise avec l’AI Act et les obligations liées aux GPAI. Les standards se stabilisent, notamment avec ISO/IEC 42001 et ISO/IEC 23894. Les risques, eux, sont désormais clairement identifiés, comme le montre l’OWASP LLM Top 10.

La bonne nouvelle est qu’il n’est pas nécessaire de lancer un programme lourd et monolithique pour avancer. Ce qui compte, ce sont des bases solides : un inventaire clair, des contrôles concrets et une auditabilité de l’IA réellement praticable. Le reste se construit progressivement, au rythme des déploiements, à condition de ne pas perdre la maîtrise du système.

Un test simple permet de se situer. Si demain un régulateur, un auditeur ou un client vous demande d’expliquer une décision prise par un système d’IA, pouvez-vous la décrire et la reproduire de manière fiable ? Si la réponse est non, alors la priorité est déjà connue.

Chez Eulidia, nous abordons la gouvernance de l’IA en entreprise, la gouvernance de la sécurité de l’IA et l’auditabilité d’un système d’IA comme des leviers opérationnels, pas comme des exercices théoriques. Notre approche vise à concilier exigences réglementaires, maîtrise des risques et capacité à délivrer de la valeur en production. Concrètement, cela signifie aider les organisations à structurer leurs usages, à produire des preuves exploitables et à industrialiser leurs systèmes d’IA sans ralentir leurs équipes.

FAQs about l’auditabilité et la sécurité de l’IA

Que signifie l’auditabilité pour les systèmes d’intelligence artificielle ?

L’auditabilité d’un système d’IA désigne la capacité à retracer, comprendre et vérifier les décisions et le fonctionnement d’un système d’intelligence artificielle tout au long de son cycle de vie. Cela inclut la conception, l’entraînement, la mise en production et l’évolution du modèle.

Elle repose sur la documentation, la traçabilité des données et des versions de modèles, ainsi que la conservation de preuves liées aux tests, aux validations et aux mises à jour, afin de répondre aux exigences réglementaires et aux besoins d’explicabilité.

Quelles sont les bonnes pratiques pour garantir la conformité réglementaire ?

Garantir la conformité repose sur plusieurs piliers complémentaires. Il est essentiel de mettre en place une gouvernance de l’IA formalisée, de documenter les processus de développement, d’automatiser la collecte des logs et des métriques, et de tester régulièrement la qualité des données et les biais algorithmiques.

Ces pratiques facilitent le travail des auditeurs et permettent de démontrer que les systèmes respectent les exigences réglementaires en vigueur.

Comment les auditeurs évaluent-ils les risques liés à l’IA ?

Les auditeurs analysent la gestion globale des risques liés à l’IA. Ils examinent la présence de biais, la fiabilité des données et des modèles, l’efficacité des contrôles internes et la conformité réglementaire.

Ils s’intéressent également à la capacité de l’organisation à assurer une surveillance continue, à documenter les décisions et à maîtriser les risques sur l’ensemble du cycle de vie des systèmes d’intelligence artificielle.

Comment documenter les systèmes d’IA pour faciliter un audit ?

La documentation doit couvrir l’ensemble des éléments structurants du système. Cela inclut les jeux de données utilisés, les traitements appliqués, les versions de modèles, les paramètres clés, les résultats de tests et les décisions de mise en production.

Il est également indispensable de documenter les processus de gouvernance de l’IA en entreprise, les contrôles de surveillance continue et les actions correctives mises en œuvre pour garantir la conformité et la transparence.

Quelles obligations les régulateurs imposent-ils en matière d’auditabilité ?

Les obligations varient selon les juridictions, mais elles reposent généralement sur des exigences de transparence, d’explicabilité, de gestion des risques et de documentation.

Les entreprises doivent démontrer la traçabilité des décisions, la conformité aux règles anti discrimination et la mise en place de mécanismes de supervision humaine et de contrôle continu, en particulier pour les systèmes à risque élevé.

Comment intégrer l’auditabilité à la gestion des risques liés à l’IA ?

Intégrer l’auditabilité de l’IA à la gestion des risques consiste à cartographier les usages, identifier les risques associés et définir des seuils de tolérance. Cela implique également de mettre en place des tests de robustesse, des scénarios de défaillance, des mécanismes de détection d’anomalies et des preuves de conformité exploitables.

La gouvernance doit prévoir des revues régulières et des plans d’atténuation pour garantir la fiabilité des systèmes.

Quels outils et méthodes sont utilisés pour un audit d’IA efficace ?

Les auditeurs s’appuient sur des outils d’analyse des modèles, des plateformes de gestion des logs, des frameworks d’explicabilité et de détection des biais, ainsi que sur des mécanismes de surveillance en temps réel.

Ils exploitent également la documentation des processus, les informations nécessaires à l’audit et les contrôles automatisés pour évaluer la conformité réglementaire et la maîtrise des risques.

Comment préparer une entreprise à une inspection réglementaire sur l’IA ?

La préparation repose sur l’anticipation. Une entreprise doit structurer sa gouvernance IA, produire des preuves de conformité, maintenir à jour les rapports de tests et démontrer la surveillance continue des systèmes.

Il est également essentiel d’identifier clairement les responsables, de formaliser les procédures de mise sur le marché et de réaliser des audits internes réguliers afin d’être prêt face aux autorités de régulation.

Quelles étapes permettent de limiter les risques liés à l’IA générative ?

Limiter les risques liés à l’IA générative commence par l’évaluation des cas d’usage et de leurs impacts. Il faut ensuite contrôler la qualité des données, tester les outputs pour détecter les biais ou comportements indésirables, documenter les choix algorithmiques et maintenir une supervision humaine adaptée.

Des mécanismes de contrôle continu, des limites d’utilisation et des plans de réponse aux incidents sont indispensables pour garantir la fiabilité et la conformité des systèmes.