Une plateforme data cloud souverain bien conçue permet d’exploiter pleinement la valeur des données – BI, temps réel, IA – sans sacrifier la conformité, la confidentialité ni la maîtrise juridique. Concrètement, l’objectif est de construire un lakehouse industrialisé, avec des accès strictement encadrés et une sécurité by design pensée dès l’infrastructure. Pour poser les bases de l’architecture, notre article sur l’architecture cloud présente les fondations avant d’entrer dans les choix techniques plus avancés.

Dans les grands groupes, la question n’est plus « cloud ou pas cloud ? », mais plutôt quel service cloud et quel modèle d’exploitation adopter pour préserver la cloud data sovereignty tout en accélérant l’innovation. Et lorsque l’on parle de données de santé ou de données sensibles, le choix d’un hébergement, d’une offre cloud qualifiée SecNumCloud, et d’une trajectoire MLOps devient un sujet stratégique au niveau de la direction, pas seulement un sujet IT.

Pourquoi un cloud souverain pour une plateforme de données de santé ?

Quand les données concernent les patients, l’assurance ou le parcours de soin, il ne s’agit pas simplement de “stocker” des fichiers. Vous portez une responsabilité directe. Les données de santé imposent un niveau de maîtrise opérationnelle, contractuelle et technique particulièrement élevé, y compris sur toute la chaîne de sous-traitance.

La moindre ambiguïté sur l’accès aux données, la traçabilité des opérations ou la localisation de l’hébergement peut générer des risques importants, à la fois juridiques et réputationnels. C’est précisément dans ce contexte qu’une plateforme data cloud souverain prend tout son sens.

Données de santé : enjeux, risques et responsabilités

Les référentiels français et européens renforcent progressivement les exigences de contrôle. Ils imposent notamment des mécanismes stricts de cloisonnement, de journalisation, de réversibilité, de plan de continuité et de capacité d’audit.

En matière d’hébergement de données de santé à caractère personnel pour le compte d’un tiers, le recours à un hébergeur certifié HDS devient central.

Cette certification repose sur un ensemble d’exigences structurées portant sur la sécurité, la gouvernance et l’exploitation des infrastructures.

Depuis l’évolution du cadre réglementaire en 2024, la localisation de l’hébergement physique dans l’Espace économique européen est explicitement mise en avant. Cette évolution influence directement les choix d’architecture pour les organisations qui construisent une cloud data platform manipulant des données sensibles.

Souveraineté et résidence des données : exigences concrètes et impacts d’architecture

La cloud data sovereignty ne relève pas d’un principe abstrait. Elle correspond à un ensemble d’exigences concrètes : juridiction applicable, contrôle des opérations, accès administratif, gestion du support et supervision de la chaîne de sous-traitance.

Ces exigences se traduisent très concrètement dans l’architecture technique. Par exemple : qui administre l’hyperviseur, où sont gérées les clés de chiffrement, qui peut accéder aux sauvegardes ou encore comment sont sécurisés les flux entre différentes zones de la plateforme.

Dans la pratique, cette souveraineté se joue souvent dans les détails. Les clauses contractuelles, la gouvernance opérationnelle et la capacité d’audit deviennent alors des éléments structurants d’une cloud data platform manipulant des données critiques.

Cloud de confiance et SecNumCloud : ce que cela garantit (et ce que cela ne garantit pas)

En France, la qualification SecNumCloud, délivrée par l’ANSSI, constitue aujourd’hui l’un des repères les plus clairs pour identifier un environnement cloud répondant à des exigences élevées de sécurité et de souveraineté.

Elle définit un ensemble d’exigences techniques, opérationnelles et juridiques visant à protéger les environnements cloud manipulant des données sensibles. Pour certaines organisations, notamment dans les secteurs critiques, elle représente un cadre de référence solide.

Cependant, il est important de rappeler une chose essentielle. SecNumCloud ne garantit pas automatiquement la sécurité de votre plateforme Data.

Même si l’infrastructure du fournisseur est qualifiée, la responsabilité reste partagée. La gouvernance des accès, la gestion des secrets, la sécurisation des pipelines ou encore l’architecture MLOps restent sous la responsabilité de l’organisation qui exploite la cloud data platform.

Cadre réglementaire et exigences de conformité

La question de la cloud data sovereignty se traite en alignant réglementation, analyse de risque et architecture cible. Dans les comités de pilotage, on peut simplifier la lecture de la manière suivante : RGPD pour le traitement des données, HDS pour l’hébergement des données de santé, SecNumCloud pour la robustesse de l’environnement cloud, et une analyse de risque sur l’extraterritorialité, notamment liée au CLOUD Act.

Une fois ces éléments clarifiés, il devient possible de choisir la stack technique adaptée pour une cloud data platform manipulant des données sensibles.

HDS, RGPD et politique de sécurité : obligations clés à traduire en architecture

Le RGPD (Règlement (UE) 2016/679) constitue le cadre européen de protection des données personnelles. Il impose la mise en place de mesures techniques et organisationnelles adaptées au niveau de risque, ainsi que le principe d’accountability, c’est-à-dire la capacité de démontrer la conformité.

Dans le domaine de la santé, le référentiel HDS (Hébergement de Données de Santé) définit des exigences opérationnelles concrètes. Il couvre notamment la gestion des incidents, le contrôle des accès, la sauvegarde des données, la capacité de produire des preuves et la gouvernance de la sous-traitance.

Dans une plateforme data cloud souverain, ces exigences se traduisent directement dans l’architecture technique. On retrouve par exemple :

- segmentation réseau

- chiffrement des données

- journalisation des accès

- traçabilité des opérations permettant de savoir qui a fait quoi et à quel moment

SecNumCloud : principes, périmètre et partage des responsabilités

Le référentiel SecNumCloud, porté par l’ANSSI, définit un ensemble d’exigences destinées à garantir un haut niveau de sécurité pour les environnements cloud manipulant des données sensibles. (cert.ssi.gouv.fr)

Il couvre notamment :

- le chiffrement des données

- le cloisonnement entre clients

- la protection des accès aux services cloud, y compris portails et API

- les exigences juridiques liées à l’exploitation du service

-

Dans une cloud data platform, ces exigences influencent directement les choix d’architecture. Cela peut impliquer :

- le recours à un environnement cloud qualifié SecNumCloud

- une séparation claire des rôles entre administration infrastructure et administration sécurité

- l’utilisation systématique d’un KMS ou d’un HSM pour la gestion des clés

-

Autrement dit, même l’architecture lakehouse la plus avancée peut devenir fragile si la gestion des clés de chiffrement n’est pas correctement gouvernée.

CLOUD Act et extraterritorialité : analyse de risque et mesures de mitigation

Le CLOUD Act, adopté aux États-Unis en 2018, introduit un cadre juridique permettant à certaines autorités américaines de demander l’accès à des données électroniques dans le cadre d’enquêtes pénales, selon la chaîne de contrôle juridique du fournisseur.

Le sujet n’est pas un accès automatique aux bases de données, mais un risque potentiel d’injonction ou de communication de données, en fonction de la juridiction applicable aux opérateurs cloud.

Dans certains contextes, la CNIL recommande de privilégier des prestataires soumis exclusivement au droit européen. Elle souligne également l’intérêt des environnements qualifiés SecNumCloud pour réduire certains risques liés à l’extraterritorialité.

L’enjeu n’est pas politique, mais relève de la gestion des risques. Les organisations doivent analyser leur exposition potentielle et adapter leur architecture en conséquence.

Parmi les mesures de mitigation couramment mises en œuvre :

- chiffrement fort des données

- des mécanismes de chiffrement avec une maîtrise effective des clés, par exemple via des approches BYOK ou HYOK selon les cas

- limitation des métadonnées exposées aux services cloud

- clauses contractuelles strictes encadrant la chaîne de sous-traitance

Architecture cible d’une plateforme data souveraine (vue d’ensemble)

Une cloud data platform souveraine ne se résume pas à une seule brique technologique. Il s’agit d’une chaîne complète : ingestion → stockage → traitement → exposition → intelligence artificielle, avec des mécanismes de sécurité et de gouvernance présents à chaque étape.

Chez Eulidia, l’approche reste volontairement pragmatique : partir des usages métiers, puis construire une plateforme simple à opérer, cohérente dans la durée et alignée avec les contraintes réglementaires et opérationnelles de l’organisation.

Principes directeurs : isolation, traçabilité, chiffrement, moindre privilège

Quatre principes reviennent systématiquement lorsqu’il s’agit de répondre aux exigences de cloud data sovereignty :

- Isolation des environnements : production, développement et sandbox pour les expérimentations IA doivent être clairement séparés.

- Traçabilité de bout en bout : journaux d’accès, lineage des données et traçabilité des actions administratives.

- Chiffrement systématique : données chiffrées au repos et en transit, avec une gestion robuste des clés.

- Principe du moindre privilège : modèles RBAC ou ABAC combinés à une séparation stricte des rôles.

Ces principes structurent l’architecture et garantissent que la souveraineté des données n’est pas seulement déclarative, mais réellement implémentée.

Architecture de référence : ingestion → stockage → traitement → exposition → IA

Sur le terrain, une architecture robuste suit généralement un schéma relativement stable. On retrouve d’abord une zone d’atterrissage pour l’ingestion des données, en batch ou en streaming.

Les données sont ensuite stockées dans un lakehouse structuré en couches bronze, silver et gold. Les traitements sont réalisés via des moteurs analytiques tels que SQL engines, Spark ou outils de transformation type dbt.

Enfin, les données sont exposées via plusieurs surfaces :

- outils de BI

- produits de données

- API

- environnements IA ou data science

-

L’infrastructure doit permettre une forte élasticité tout en conservant des garde-fous opérationnels. Cela passe notamment par des quotas de ressources, des contrôles réseau et des politiques d’accès centralisées.

Modèle d’exploitation : DevSecOps, observabilité, incidents et audits

Une architecture bien conçue ne suffit pas. Sans un modèle d’exploitation solide, la plateforme devient rapidement difficile à gouverner.

L’industrialisation passe généralement par des pratiques DevSecOps :

- infrastructure as code

- pipelines CI/CD

- tests de sécurité automatisés

- supervision et observabilité des workloads

Dans un contexte de cloud data platform souveraine, la capacité d’audit est également essentielle. Il faut pouvoir produire des preuves : journaux immuables, revues régulières des accès, et tests de plan de reprise d’activité.

Chez Eulidia, nous insistons également sur le pilotage coûts / valeur. La gouvernance FinOps permet d’éviter les dérives budgétaires, notamment lorsque les workloads d’intelligence artificielle ou les usages GPU augmentent.

Pour approfondir ce sujet, notre article consacré à l’optimisation des coûts du cloud constitue un bon complément.

Stockage et traitement : le lakehouse en environnement souverain

Le lakehouse s’impose aujourd’hui comme un compromis efficace entre flexibilité et performance. Il combine la souplesse d’un data lake avec les capacités analytiques d’un data warehouse. Dans le cas de données réglementées, son intérêt dépasse la performance : il permet de mettre en place un modèle de gouvernance unifié, de limiter les duplications de données et de simplifier la traçabilité.

Dans un contexte de cloud data sovereignty, réduire la multiplication des copies de données permet également de diminuer les surfaces d’exposition et les risques de sécurité.

Pourquoi le lakehouse plutôt qu’un data warehouse ou un data lake pour des données sensibles

Un data warehouse classique facilite l’analytique et la structuration des données, mais peut rapidement rigidifier les usages et encourager des contournements lorsque les besoins évoluent.

À l’inverse, un data lake brut offre une grande liberté mais peut rapidement se transformer en “data swamp” si la gouvernance n’est pas suffisamment structurée.

Le lakehouse propose un équilibre plus adapté aux environnements sensibles. Il permet de combiner :

- formats ouverts et standards

- gestion transactionnelle des données

- catalogue centralisé

- mécanismes de qualité et de contrôle

Correctement implémenté, il permet de renforcer la sécurité et la gouvernance sans freiner l’innovation au sein d’une cloud data platform.

Zonage et classification des données : bronze, silver, gold et données identifiantes

Le zonage des données constitue un mécanisme central pour structurer une plateforme data cloud souverain.

L’architecture lakehouse repose généralement sur trois niveaux :

- bronze : données brutes issues de l’ingestion

- silver : données nettoyées et enrichies

- gold : données prêtes à l’usage analytique ou métier

À cette logique de transformation s’ajoute souvent une classification par sensibilité. On distingue alors :

- données directement identifiantes

- données pseudonymisées

- données agrégées ou anonymisées

Cette approche permet de réserver une infrastructure plus contrôlée pour les données les plus sensibles, tout en isolant les usages moins critiques. C’est souvent à ce niveau que les exigences de cloud data sovereignty deviennent concrètes dans l’architecture.

Gouvernance : catalogue, lineage, qualité, rétention et anonymisation

La gouvernance des données ne se limite pas à des processus organisationnels. Elle repose sur un système technique structuré.

Une cloud data platform souveraine doit intégrer plusieurs mécanismes :

- catalogue de données centralisé

- lineage permettant de suivre la circulation des données

- règles de qualité et de validation

- politiques de rétention et de suppression

- mécanismes d’anonymisation ou de pseudonymisation

La traçabilité doit également couvrir les évolutions des systèmes : versions de schémas, transformations appliquées, modèles utilisés et jeux d’entraînement pour l’IA.

Dans une architecture orientée cloud data sovereignty, l’objectif est simple : pouvoir démontrer rapidement comment une donnée a été transformée, qui y a accédé et dans quel contexte cet accès a été autorisé.

Sécurité by design : contrôles incontournables

À ce stade, il ne s’agit plus de déclarations d’intention. Une cloud data platform secure by design repose sur des contrôles techniques et opérationnels clairement définis, alignés sur des référentiels de sécurité et vérifiables lors d’audits.

Dans le contexte d’une plateforme data cloud souverain, ces contrôles doivent couvrir l’ensemble de la chaîne : infrastructure, plateforme et usages. Le référentiel SecNumCloud impose déjà un niveau d’exigence élevé côté opérateur. L’objectif est donc d’atteindre un niveau de maturité comparable au niveau de la plateforme et des pratiques d’exploitation.

Les contrôles incontournables incluent notamment :

- Chiffrement des données au repos et en transit, avec gestion robuste des clés via KMS ou HSM, modèles BYOK ou HYOK, rotation régulière et journalisation des opérations liées aux clés.

- Gestion des identités et des accès (IAM) : modèles RBAC ou ABAC, authentification forte (MFA), accès administratifs via bastion, séparation stricte des rôles et revues périodiques des habilitations.

- Sécurité de la plateforme et des applications : durcissement des environnements, gestion sécurisée des secrets, politique de patching, scans de sécurité intégrés dans les pipelines CI/CD.

- Journalisation et détection des incidents : journaux immuables, intégration avec un SIEM, supervision continue, mécanismes d’alerting et playbooks de réponse aux incidents.

- Continuité d’activité : sauvegardes régulières, plans PRA et PCA, tests de restauration périodiques et objectifs de reprise mesurables. Dans une plateforme data critique, la capacité à restaurer rapidement les systèmes fait pleinement partie de la sécurité opérationnelle.

Intégrer l’IA sans compromettre la souveraineté

L’IA en entreprise représente à la fois une opportunité majeure et un risque potentiel si elle est déployée sans cadre adapté. Le point clé consiste à pouvoir développer et déployer des modèles ou des assistants sans exposer les données internes à un cloud public non maîtrisé.

Une stratégie alignée avec la cloud data sovereignty repose généralement sur un socle MLOps interne, capable d’entraîner, versionner et déployer les modèles dans un environnement contrôlé, avec éventuellement des connexions vers des services externes lorsque cela est nécessaire.

Cas d’usage santé : NLP, imagerie, prédiction et aide à la décision

Dans le domaine de la santé, plusieurs cas d’usage sont déjà bien identifiés :

- extraction NLP à partir de comptes rendus médicaux

- analyse d’imagerie assistée par IA

- prédiction de réadmission ou de complications

- systèmes d’aide à la décision clinique

Chaque cas d’usage doit cependant intégrer des garde-fous stricts : minimisation des données, contrôle des accès et mécanismes d’explicabilité adaptés aux contextes médicaux.

Un autre sujet souvent sous-estimé concerne la confidentialité du modèle lui-même. Un modèle mal entraîné peut mémoriser des fragments de données sensibles. La stratégie d’entraînement doit donc éviter que les modèles reproduisent ou exposent des informations patient.

Stratégies d’entraînement : données souveraines, apprentissage fédéré ou données synthétiques

Plusieurs approches permettent de développer des modèles tout en respectant les contraintes de souveraineté :

- entraînement dans un environnement souverain isolé, par exemple une sandbox dédiée

- apprentissage fédéré, permettant d’entraîner un modèle sans centraliser les données

- utilisation de données synthétiques pour limiter l’exposition des données sensibles

L’objectif n’est pas de suivre une tendance technologique, mais de définir un niveau de risque acceptable.

Dans certains contextes réglementaires, les organisations choisissent d’entraîner leurs modèles dans un environnement qualifié SecNumCloud, puis de n’exposer que des artefacts contrôlés, comme des modèles ou des embeddings.

Dans la pratique, la capacité GPU devient rapidement un sujet à part entière, à la fois en termes de coûts et de disponibilité des ressources.

Déploiement des modèles : MLOps souverain, registry et reproductibilité

Un environnement MLOps souverain doit garantir la traçabilité et la reproductibilité des modèles.

Cela implique généralement :

- un model registry centralisé

- des pipelines d’entraînement reproductibles

- des environnements versionnés pour les expérimentations

- une traçabilité complète des données et des paramètres utilisés

Ces mécanismes permettent de rejouer un entraînement, d’expliquer une décision algorithmique et de démontrer les conditions dans lesquelles un modèle a été produit.

Dans une cloud data platform souveraine, ils contribuent également à limiter les risques d’exfiltration de données, notamment via des contrôles réseau, des quotas et des politiques strictes sur les connecteurs sortants.

Protection des données et des modèles : anti-exfiltration, isolation et contrôle des prompts

Avec l’essor de la GenAI, les prompts eux-mêmes peuvent devenir un vecteur de fuite d’informations. Ils doivent être considérés comme un canal potentiel d’exposition de données sensibles.

Les bonnes pratiques incluent :

- isolation des environnements IA

- filtrage et journalisation des prompts et des réponses

- limitation des sorties et des connecteurs externes

Enfin, la gouvernance doit également couvrir les responsabilités contractuelles. Par exemple : qui est responsable si un modèle génère ou expose un extrait de données sensibles ?

Ces questions doivent être traitées dès la conception du projet, au même niveau que l’architecture technique, la sécurité et les arbitrages budgétaires.

Choisir un fournisseur cloud souverain et réussir le déploiement

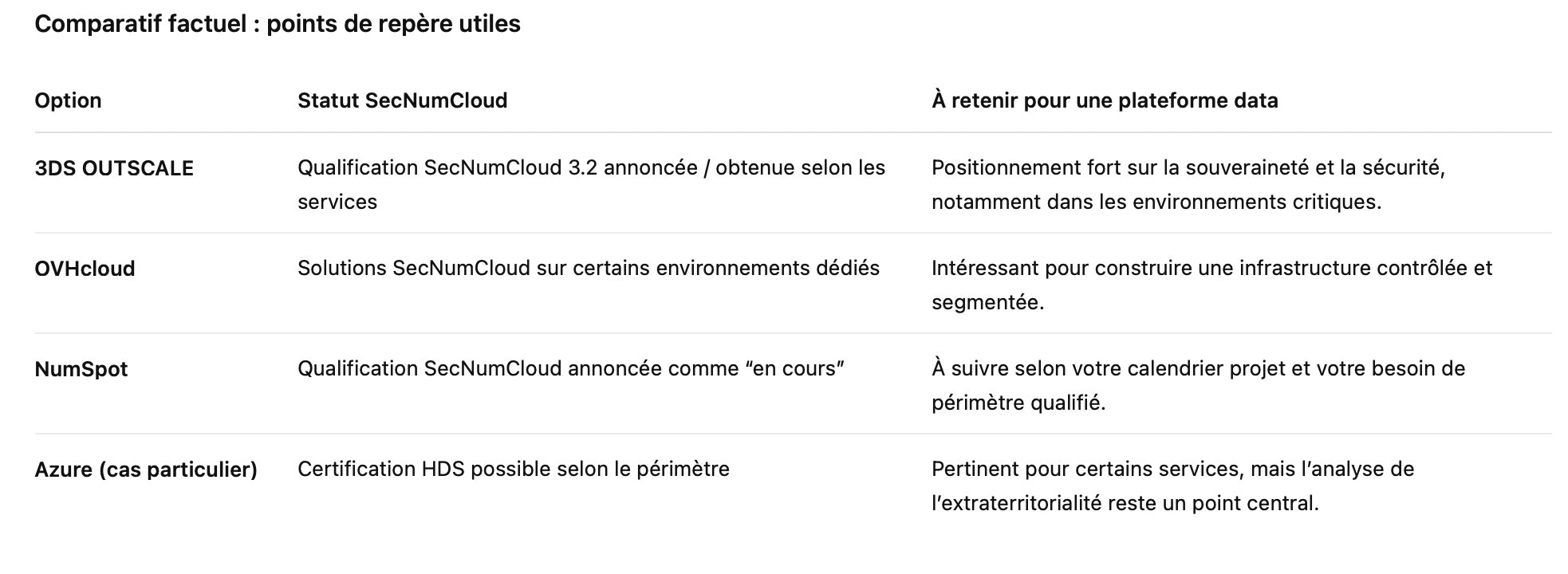

Le terme fournisseur cloud souverain recouvre aujourd’hui des réalités très différentes. On trouve des opérateurs déjà qualifiés SecNumCloud, des acteurs en cours de qualification, ou encore des offres européennes proposant certaines garanties de souveraineté sans qualification complète.

Le choix dépend aussi fortement des services disponibles : Kubernetes managé, services data, stockage objet, capacités réseau, support opérationnel et conditions de réversibilité. Pour une cloud data platform, ces éléments deviennent rapidement déterminants dans la durée.

Si votre contexte impose un cloud de confiance strict, il est préférable de viser un périmètre SecNumCloud clairement qualifié, plutôt qu’une simple promesse marketing.

Par ailleurs, lorsque l’organisation dispose d’un environnement Hadoop ou on-premise important, une migration progressive est souvent préférable à une transformation “big bang”. Une trajectoire par étapes permet de sécuriser la transition et de limiter les risques opérationnels.

Réussir le déploiement : cadrage, pilotes, montée en charge et run

Dans la pratique, les déploiements réussis suivent souvent un même schéma :

- Cadrage : analyse des risques, classification des données et définition des SLA.

- Pilote : déploiement d’un premier cas d’usage à forte valeur.

- Industrialisation : mise en place des pipelines CI/CD, de l’observabilité et des mécanismes de gouvernance.

- Généralisation : montée en charge progressive et intégration dans le modèle de run.

Chez Eulidia, l’accompagnement intervient souvent à la jonction entre stratégie et exécution. L’objectif est d’aligner les équipes métiers et IT, de définir une trajectoire réaliste et de livrer un socle de plateforme data réellement exploitable.

Les pages dédiées à la stratégie data, la transformation data, le delivery data et les technologies cloud détaillent cette approche de transformation de bout en bout.

Conclusion : la check-list pour une plateforme data souveraine, du lakehouse à l’IA

En résumé, une plateforme data cloud souverain réussie repose sur trois piliers : un lakehouse gouverné, une sécurité by design vérifiable, et une intégration de l’IA maîtrisée, sans exposition inutile des données.

La souveraineté ne se déclare pas. Elle se démontre à travers l’architecture, les contrats et le modèle d’exploitation. Ce n’est pas un logo ni un label qui garantit la souveraineté, mais la cohérence entre infrastructure, gouvernance et pratiques opérationnelles.

Cela implique aussi des arbitrages concrets : choix des services disponibles, maîtrise des coûts, stratégie de réversibilité, et délais liés aux qualifications comme SecNumCloud.

Prochaine étape : passer de la stratégie au terrain

La prochaine étape consiste souvent à lancer un atelier de cadrage ou un audit de maturité. L’objectif est de cartographier les données, définir les exigences de souveraineté et identifier où doivent résider les données les plus sensibles.

À partir de cette base, il devient possible de construire un POC lakehouse et MLOps, puis de déployer progressivement la plateforme, avec un modèle de run réellement opérationnel.

C’est généralement à ce moment-là que l’innovation cesse d’être un projet expérimental pour devenir une capacité durable de l’organisation.

FAQs

Qu’est-ce qu’une plateforme data cloud souverain et pourquoi la souveraineté numérique est-elle importante ?

Une plateforme data cloud souverain est une infrastructure de données opérée dans un environnement cloud garantissant un haut niveau de contrôle sur l’hébergement, les accès et la gouvernance des données.

Elle permet notamment de conserver la maîtrise des clés de chiffrement, de limiter les dépendances juridiques extraterritoriales et de répondre aux exigences réglementaires liées aux données sensibles. Dans un contexte européen, la cloud data sovereignty devient un élément central pour les organisations manipulant des données stratégiques ou réglementées.

Comment une plateforme cloud souveraine peut-elle répondre à des exigences de sécurité élevées ?

Une cloud data platform souveraine repose sur plusieurs mécanismes de sécurité :

- infrastructures cloud qualifiées SecNumCloud ou équivalent

- politiques strictes de gestion des identités et des accès

- chiffrement des données au repos et en transit

- journalisation et traçabilité des opérations

- audits réguliers et contrôles de conformité

Ces mécanismes permettent de protéger des données sensibles, notamment dans des secteurs réglementés comme la santé, la finance ou les services publics.

Peut-on déployer des workloads d’intelligence artificielle sur une plateforme cloud souveraine ?

Oui. Les plateformes cloud souveraines peuvent supporter des workloads d’intelligence artificielle, y compris des environnements nécessitant des GPU pour l’entraînement ou l’inférence des modèles.

Dans ce contexte, les organisations mettent généralement en place un socle MLOps souverain, permettant de gérer l’entraînement des modèles, la traçabilité des données et la gouvernance des artefacts tout en respectant les exigences de cloud data sovereignty.

Quelle est la différence entre cloud public, cloud européen et cloud souverain ?

Un cloud public est opéré par des fournisseurs globaux tels que Google Cloud, AWS ou Microsoft Azure, avec des infrastructures distribuées à l’échelle mondiale.

Le terme “cloud européen” renvoie le plus souvent à des offres opérées par des acteurs établis en Europe et soumis au droit européen, sans constituer pour autant une qualification réglementaire en soi.

Un cloud souverain va plus loin. Il garantit un contrôle renforcé sur l’infrastructure, les opérations et la chaîne de sous-traitance, afin de réduire les risques liés à l’extraterritorialité et de renforcer la souveraineté des données.

Comment garantir la conformité pour les données de santé ?

La gestion des données de santé repose sur plusieurs cadres réglementaires et référentiels :

- conformité au RGPD

- recours à un hébergement certifié HDS

- contrôles de sécurité renforcés

- gouvernance stricte des accès et des traitements

Dans certains contextes, l’utilisation d’un environnement cloud qualifié SecNumCloud peut également renforcer la sécurité et la conformité de l’infrastructure.

Quels sont les bénéfices d’une plateforme data cloud souverain pour les organisations ?

Pour les entreprises et les administrations, une plateforme data cloud souverain apporte plusieurs avantages :

- maîtrise accrue des données et des accès

- réduction des risques juridiques liés à l’extraterritorialité

- conformité avec les exigences réglementaires

- sécurisation des projets data et IA

- capacité d’innovation tout en conservant un contrôle fort sur l’infrastructure

Elle permet ainsi de concilier transformation numérique, exploitation avancée des données et exigences de cloud data sovereignty.

.svg)