Industrialiser le machine learning et l’IA en 2026 ne consiste plus à entraîner de meilleurs modèles. L’enjeu est ailleurs : rendre les modèles fiables, observables, gouvernables et rentables dans la durée. La vraie question n’est plus « peut-on prédire ? », mais « peut-on déployer, surveiller, corriger et expliquer sans ralentir le métier ? ». C’est précisément à ce niveau que l’industrialisation fait la différence, bien au-delà de la seule performance algorithmique.

Chez Eulidia, nous le constatons sur le terrain. Les organisations savent expérimenter. Elles savent produire des démonstrateurs convaincants. Mais entre un pilote réussi et un système réellement utilisé en production, l’écart reste considérable. Industrialiser, c’est traiter simultanément des sujets d’architecture, d’exploitation, de gouvernance et d’adoption, autant que de machine learning.

Le constat : des PoC convaincants, peu de systèmes réellement en production

Dans la plupart des grandes entreprises, les preuves de concept se multiplient. En revanche, le passage à la production reste un goulot d’étranglement majeur. Un signal fort le confirme. Selon un rapport 2025 sur la GenAI en entreprise, seules 5 % des initiatives atteindraient la production, malgré un enthousiasme initial très élevé. Ce décalage reflète une réalité largement partagée : le modèle fonctionne en environnement contrôlé, puis le monde réel s’impose, avec ses données mouvantes, ses contraintes de sécurité, ses processus métiers et ses exigences de run.

En parallèle, la course aux modèles s’accélère. L’AI Index 2025 de Stanford montre que près de 90 % des modèles notables publiés en 2024 proviennent désormais d’acteurs industriels. L’avantage compétitif ne se joue donc plus uniquement sur l’entraînement ou l’algorithme, mais sur la capacité à industrialiser, à gouverner et à maintenir les modèles dans la durée.

En 2026, la différence se joue sur l’industrialisation, pas sur « un meilleur modèle »

Un modèle peut atteindre 95 % de précision en laboratoire et pourtant échouer à créer de la valeur. Une prédiction, à elle seule, ne suffit pas. Pour produire un impact business mesurable, il faut une chaîne complète et maîtrisée : données, décision, action et mesure. À ce stade, les sujets les plus opérationnels deviennent décisifs. Latence, droits d’accès, coûts cloud, exploitation, conformité et gestion du run conditionnent directement le succès.

L’objectif de cet article est volontairement pragmatique. Il s’agit de proposer une méthode pour identifier les blocages, construire un socle réaliste et démontrer le ROI de l’IA sans promesses floues. Il ne s’agit pas de tout figer sur dix-huit mois, mais d’avancer par étapes, avec des garde-fous, afin de déployer plus vite sans créer une dette difficile à rattraper.

Ce qui change entre un PoC et un système « production ready »

C’est précisément à ce moment-là que beaucoup de projets décrochent.

Entre une expérimentation prometteuse et un système réellement exploité en production, le changement de nature est profond.

PoC : valider une hypothèse. Production : délivrer une capacité durable.

Un PoC répond à une question simple : « Est-ce que ça marche ? »

En production, la question change radicalement : « Est-ce que ça marche tous les jours, pour tout le monde, de manière sécurisée et à coût maîtrisé ? »

L’écart est considérable. Un modèle en production doit être robuste aux variations de données, intégré au système d’information, supervisé dans le temps et opéré comme un service critique. On ne parle plus seulement de performance statistique, mais de delivery ML, de fiabilité et de continuité d’exploitation.

Concrètement, le passage à la production introduit des exigences nouvelles. Sécurité, conformité au RGPD, auditabilité, support et adoption deviennent non négociables. Le RGPD s’impose dès que des données personnelles sont en jeu. L’AI Act ajoute, pour certains cas d’usage, des obligations explicites de gestion des risques, de documentation et de contrôle sur l’ensemble du cycle de vie des modèles. À ce stade, l’industrialisation du machine learning devient un sujet d’organisation autant que de technique.

Les signaux d’alerte d’un PoC qui ne passera pas à l’échelle

Si plusieurs points ci dessousvous semblent familiers, le PoC concerné est probablement une impasse. Ou, au mieux, un futur chantier de rattrapage coûteux. Et oui, il suffit parfois d’un peu plus de rigueur dès le départ pour éviter des mois de reprise plus tard.

- Données fragiles

Sources non maîtrisées, qualité variable, absence de traçabilité ou de contrats de données. - Pipeline manuel

Notebooks « magiques », traitements lancés à la main, absence de tests et de pipelines ML reproductibles. - Ownership flou

Aucun responsable clairement identifié, ni côté IT, ni côté métier. La gouvernance IA reste implicite. - KPI métier absent

Le modèle est optimisé sur un score technique, mais aucun lien n’est établi avec des KPI métier ou le ROI de l’IA. - Monitoring inexistant

Pas de monitoring des modèles, dérives non détectées, incidents tardifs et coûts qui augmentent sans alerte.

Ce constat n’est pas une critique des équipes. C’est une réalité structurelle. Un PoC privilégie la vitesse et l’exploration. La production, elle, exige de la répétabilité, de la visibilité et de la maintenabilité. C’est précisément là que se joue la différence entre une expérimentation prometteuse et un système réellement industrialisé.

Facteurs clés pour industrialiser le ML en 2026 : le socle MLOps

Un socle MLOps ne se résume pas à un ensemble d’outils. Il repose sur plusieurs briques complémentaires, qui doivent évoluer de concert. La première, et souvent la plus structurante, concerne l’infrastructure et la donnée. Dans la pratique, c’est souvent là que les projets se grippent : des modèles performants, mais des fondations trop fragiles pour tenir en production.

Infrastructure et data : le socle (cloud, sécurité, conformité)

En 2026, le débat « cloud vs on prem » est rarement idéologique. Il est avant tout pragmatique. Sensibilité des données, latence, exigences sectorielles, contraintes réglementaires, coûts et compétences disponibles orientent les choix. Certaines organisations conservent des briques on prem, mais adoptent des architectures hybrides pour accélérer l’entraînement, le déploiement de modèles et l’exploitation. L’enjeu ne se limite plus à la puissance de calcul. Il inclut désormais FinOps, résilience et capacité à opérer dans la durée.

Sur le terrain, Eulidia met fréquemment en place des architectures cloud industrialisées, combinant infrastructure as code, pipelines CI CD, monitoring et sécurité by design. Pour approfondir l’angle technologique, la page cloud technologies détaille cette approche cloud-centric, agnostique et orientée performance et maîtrise des coûts. Elle permet surtout de poser les bases d’une plateforme MLOps capable d’évoluer sans multiplier les exceptions.

Côté data, la data readiness ne se décrète pas. Elle se construit. Qualité des données, catalogage, gestion des droits d’accès, secrets, et environnements reproductibles entre développement, staging et production sont indispensables. Sans ce socle, les modèles deviennent instables, la maintenabilité chute et les équipes passent plus de temps à corriger des incidents qu’à améliorer le ROI de l’IA.

Pipelines de déploiement et delivery : du code à l’impact

La transition entre PoC et production repose sur des pipelines ML clairs et reproductibles. Code, données, features et modèles doivent être versionnés de manière cohérente. L’objectif est double. Pouvoir reproduire un résultat à l’identique et expliquer une décision, mais aussi revenir rapidement en arrière en cas d’incident. C’est la base d’une Industrialisation du Machine Learning saine.

L’automatisation joue ici un rôle central. Tests de données, tests de régression ML, validation des performances, packaging et déploiement de modèles doivent être intégrés au pipeline. Lorsque ces contrôles restent manuels, ils deviennent rapidement un frein à la scalabilité. Le rapprochement avec le DevOps est donc naturel. Les principes de CI CD, d’observabilité et de rollback s’appliquent, mais doivent être adaptés aux spécificités du ML.

Enfin, la stratégie de mise en production doit être choisie en fonction du métier. Batch lorsque le processus le permet, temps réel lorsque la décision est immédiate. Pour les cas sensibles, les approches shadow ou canary permettent de comparer un nouveau modèle à l’existant avant bascule, réduisant ainsi les risques opérationnels.

Gouvernance IA : contrôler sans ralentir

En entreprise, la gouvernance IA n’est un frein que lorsqu’elle est purement déclarative. Lorsqu’elle est outillée, elle devient un accélérateur. L’AI Act introduit un cadre structuré de gestion des risques et de transparence, notamment pour les systèmes à risque élevé. Concrètement, cela se traduit par des points de contrôle clairs avant mise en production, des exigences de documentation et des preuves d’audit exploitables.

Des référentiels comme le NIST AI RMF offrent des repères opérationnels pour identifier, évaluer et gérer les risques sur l’ensemble du cycle de vie des modèles. À l’échelle de l’organisation, certains acteurs s’appuient également sur ISO IEC 42001 afin de structurer un système de management de l’IA, en clarifiant les rôles, les responsabilités et l’amélioration continue.

L’objectif n’est pas d’empiler des processus. Il est de pouvoir répondre simplement aux questions clés. Qui approuve un modèle. Qui l’opère. Qui est responsable en cas de dérive.

Collaboration inter équipes : le multiplicateur de vitesse

Industrialiser le ML ne repose pas uniquement sur la technologie. C’est aussi un sujet d’organisation. Les data scientists ne peuvent pas porter seuls la sécurité, la fiabilité et l’exploitation. À l’inverse, une équipe plateforme ne peut pas décider isolément des métriques ML ou des KPI métier. Les dispositifs qui fonctionnent sont ceux où data engineering, ML engineering, sécurité, produit et métier co construisent le cadre.

Dans les grandes organisations, la mise en place d’un golden path est souvent décisive. Templates projets, patterns de delivery ML, conventions de monitoring des modèles et SLA d’exploitation réduisent la complexité. Ce n’est pas spectaculaire, mais c’est ce qui permet de gérer des dizaines de modèles en production, sans perdre le contrôle, même lorsque les données et les comportements évoluent.

Les freins les plus fréquents et comment les dépasser en 2026

Même avec un socle MLOps en place, l’industrialisation peut échouer. Non pas par manque de technologie, mais à cause de blocages récurrents, souvent organisationnels ou opérationnels. Les identifier clairement permet de les traiter sans alourdir inutilement les dispositifs.

Freins organisationnels : la « PoC factory » et le run oublié

Le piège le plus courant est celui de l’usine à PoC. Les démonstrateurs s’enchaînent, portés par l’enthousiasme, mais sans vision produit, sans sponsor clairement identifié et sans budget dédié au run. Or, le coût réel d’un modèle de machine learning commence après son lancement. Suivi, incidents, ré entraînement, conformité et support représentent l’essentiel de l’effort dans la durée.

Lorsque personne ne finance explicitement cette phase, la mise en production devient un cadeau empoisonné. Le modèle fonctionne, mais il n’est ni maintenu ni opéré correctement. La responsabilité se dilue et la valeur promise ne se matérialise pas.

Le levier le plus efficace est souvent organisationnel, mais pensé comme un sujet produit. Il s’agit de cadrer chaque cas d’usage comme une capacité opérationnelle, avec un owner, une décision métier associée et un processus cible. Cette approche s’inscrit dans une data stratégie orientée cas d’usage et gouvernance IA, qui engage à la fois le métier et l’IT autour d’une feuille de route actionnable (eulidia.com).

Freins techniques : dette data, dette pipeline et absence d’observabilité

Côté technique, deux formes de dette reviennent systématiquement. La dette data d’abord, liée à la qualité, à la disponibilité et à la traçabilité des données. La dette pipeline ensuite, avec des scripts fragiles, des tâches manuelles et des environnements non reproductibles. À cela s’ajoute souvent une absence d’observabilité. Les modèles dérivent, les performances se dégradent, mais personne ne le voit avant que le métier ne se plaigne. Et à ce stade, il est généralement trop tard.

Sur le terrain, cela se traduit très concrètement par des modèles qui « fonctionnent chez leur créateur », mais que personne n’ose réellement opérer ou modifier.

Un compromis efficace consiste à adopter une approche de Minimum Viable MLOps. L’objectif n’est pas de tout industrialiser d’un coup, mais de déployer les pratiques qui apportent rapidement de la stabilité. Un registre de modèles, du versioning, du monitoring des modèles, de l’alerting et des runbooks suffisent souvent à lever une grande partie des frictions initiales.

Pour piloter l’efficacité du déploiement de modèles et des cycles de delivery ML, certaines équipes s’appuient également sur les métriques DORA, à titre d’indicateurs complémentaires. Bien qu’issues du DevOps, elles fournissent des repères utiles pour mesurer la fluidité, la fiabilité et la capacité à corriger rapidement, y compris dans des contextes ML (dora.dev).

Mesurer le ROI : du ROI d’un modèle au ROI de l’IA comme levier business

Une fois les freins levés et les modèles correctement déployés, une question s’impose naturellement : comment démontrer que ces systèmes créent réellement de la valeur pour l’entreprise ?

Aligner les métriques ML sur les KPI métier

Un modèle peut afficher un excellent AUC et rester parfaitement inutile. Cela arrive plus souvent qu’on ne l’admet. En 2026, la discipline gagnante consiste à relier explicitement les métriques ML à un KPI métier. Churn, coûts, délais, qualité ou risque deviennent les véritables indicateurs de succès. La chaîne doit être lisible : prédiction, décision, action, puis résultat mesurable. Lorsque ce lien n’est pas explicite, le modèle devient rapidement invisible pour le métier, puis indéfendable lors des arbitrages budgétaires. Sans ce lien, l’optimisation reste abstraite et le ROI de l’IA difficile à démontrer.

Sur ce point, Eulidia insiste sur un pilotage par KPI métier dès les premières phases, afin de sécuriser le passage du PoC à l’échelle et d’anticiper les exigences de gouvernance IA et de conformité. C’est une boussole simple et efficace. Si l’impact métier ne peut pas être expliqué en deux phrases, défendre le budget de run devient rapidement complexe.

Arbitrer coûts et bénéfices sans faux bons plans

Les coûts visibles sont faciles à identifier. Infrastructure, licences et quelques jours de data science figurent généralement dans tous les business cases. Les coûts cachés, en revanche, sont souvent sous estimés. Incidents, support continu, audits, ré entraînement et dette technique pèsent lourdement sur la durée.

Le choix entre construire ou acheter doit donc intégrer l’exploitation dès le départ. Une plateforme MLOps mutualisée peut réduire significativement le coût marginal d’un nouveau cas d’usage, à condition d’être pensée comme un produit interne, avec des standards de maintenabilité, de scalabilité et de support clairement définis.

Il faut également intégrer une contrainte devenue incontournable. Les modèles grossissent, l’entraînement consomme toujours plus de ressources et la pression budgétaire ne faiblit pas. L’AI Index 2025 souligne la croissance continue du compute mobilisé par les systèmes d’IA industriels. Dans ce contexte, un peu de pragmatisme vaut mieux qu’un effet de mode technologique.

Monitoring et maintenance : la garantie du ROI dans la durée

Le ROI n’est pas un événement ponctuel. C’est une courbe qu’il faut entretenir. Pour la maintenir, le monitoring des modèles devient central. Dérive des données ou du modèle, qualité des features, latence, coûts, taux d’erreur et biais éventuels doivent être surveillés en continu. Le NIST AI RMF propose un cadre et un vocabulaire utiles pour structurer cette gestion des risques sur l’ensemble du cycle de vie.

Une question reste souvent taboue, mais elle est essentielle. Quand faut-il arrêter un modèle ? Lorsque le processus métier a évolué, que les données ne reflètent plus la réalité ou que le coût d’exploitation dépasse le bénéfice généré. À l’inverse, investir dans l’amélioration est pertinent lorsque la décision métier reste valable, mais que le signal s’est affaibli. C’est cette capacité à arbitrer, à temps, qui transforme le delivery ML en véritable levier business.

Feuille de route pragmatique PoC → production en 2026

Pour éviter les plans PowerPoint qui ne survivent pas au premier comité, il est utile de raisonner en trajectoire réaliste, pensée pour des organisations complexes. Cette feuille de route repose sur trois principes simples : un socle commun, une gouvernance outillée et une montée en charge progressive. L’objectif n’est pas d’aller vite une fois, mais d’industrialiser sans casser la vitesse.

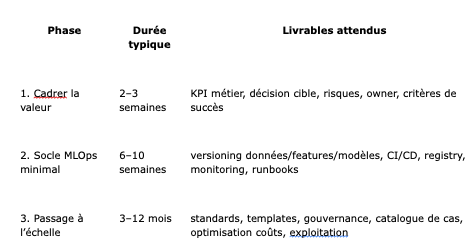

Une trajectoire en trois phases

Cette trajectoire s’inscrit naturellement dans une transformation data plus large, qui traite l’organisation, les compétences et la maturité, pas uniquement la technologie (eulidia.com). Et pour une approche résolument orientée terrain, l’article Eulidia consacré à l’architecture cloud met l’accent sur l’orchestration quotidienne et l’exploitation réelle, plutôt que sur la recherche d’une technologie « parfaite ».

Conclusion : en 2026, l’avantage compétitif vient de la capacité à livrer et maintenir

En 2026, les modèles ne suffisent plus. L’avantage compétitif se construit ailleurs : dans la capacité à industrialiser le machine learning, à maîtriser les risques et à maintenir la performance dans la durée. La différenciation ne repose plus sur un score ou une prouesse technique, mais sur l’aptitude à livrer des systèmes utiles, fiables et exploitables au quotidien.

Trois piliers se dégagent clairement. Un socle MLOps pragmatique, pensé pour le delivery et l’exploitation. Des leviers organisationnels clairs, qui alignent métier, IT et data autour de responsabilités explicites. Et un pilotage du ROI de l’IA orienté action, directement connecté aux KPI métier et aux décisions opérationnelles.

La trajectoire est volontairement simple. Cadrer la valeur. Outiller sans sur architecturer. Puis standardiser ce qui fonctionne. En gardant un principe constant : rester focalisé sur l’usage. Construire, déployer et opérer des modèles pour délivrer une valeur mesurable, sans sacrifier la conformité, la résilience ni la maintenabilité.

FAQs : Industrialisation du Machine Learning et MLOps

Comment industrialiser le machine learning et le cycle de vie des modèles de machine learning ?

L’Industrialisation du Machine Learning consiste à structurer l’ensemble du cycle de vie d’un modèle, depuis la collecte et la préparation des données jusqu’au déploiement de modèles en production et leur maintien dans le temps.

Cela implique l’orchestration des pipelines ML, le versioning des données, des features et des modèles, l’automatisation des entraînements, des tests de reproductibilité et le monitoring des modèles en production.

Une approche MLOps est centrale pour garantir la maintenabilité, la traçabilité et le ROI de l’IA, bien au-delà de la performance algorithmique initiale.

Comment déployer un modèle de machine learning via une plateforme ou une API ?

Le déploiement de modèles peut s’appuyer sur une plateforme MLOps ou sur des API REST ou gRPC exposant les modèles aux systèmes métier.

Une plateforme MLOps permet d’automatiser le packaging, la conteneurisation, les tests d’intégration et le déploiement continu, tandis qu’une API facilite l’intégration dans les applications existantes.

Pour être réellement opérationnel, un modèle doit être supervisé en continu afin de mesurer sa performance, sa latence, ses coûts et les dérives de données.

Pourquoi DevOps et MLOps sont-ils essentiels pour la mise en production des modèles ?

Le MLOps applique les principes du DevOps au machine learning. Il unifie développement des modèles, tests automatisés, CI CD, observabilité et exploitation.

L’objectif est d’automatiser les étapes répétitives comme l’entraînement, la validation et le delivery ML, tout en améliorant la reproductibilité et la collaboration entre data scientists et ingénieurs.

Cette approche réduit les frictions lors du passage à l’échelle et augmente la probabilité que les systèmes d’IA restent fiables et exploitables dans la durée.

Comment garantir la scalabilité et le passage à l’échelle des projets de machine learning ?

La scalabilité repose sur plusieurs leviers. Le choix d’architecture, l’automatisation des pipelines d’entraînement, la capacité à gérer des volumes de données croissants et l’optimisation des ressources sont déterminants.

La collaboration entre data scientists, ingénieurs MLOps et équipes infrastructure est essentielle pour dimensionner correctement les environnements et maîtriser les coûts, que les prédictions soient réalisées en temps réel ou en batch.

Quelles sont les bonnes pratiques pour entraîner et améliorer les performances d’un modèle ?

Les bonnes pratiques incluent la séparation claire des jeux d’entraînement, de validation et de test, l’utilisation de métriques adaptées aux cas d’usage, la validation croisée et le suivi continu des performances.

Le feature engineering, le choix des algorithmes et l’optimisation des pipelines ML doivent être pensés pour la production, afin d’assurer des performances durables et explicables, pas uniquement un bon score en laboratoire.

Comment automatiser le monitoring, la reproductibilité et la maintenance des modèles ?

L’automatisation du monitoring des modèles permet de détecter rapidement les dérives de données, la dégradation des performances ou les anomalies opérationnelles.

Les outils de tracking assurent la traçabilité des versions de modèles, des jeux de données et des métriques. Des workflows automatisés peuvent déclencher le réentraînement, les tests et le redéploiement lorsque certains seuils sont atteints, garantissant ainsi la maintenabilité des systèmes d’IA.

Comment mesurer le ROI des projets de machine learning et de l’industrialisation de l’IA ?

Le ROI de l’IA se mesure d’abord à travers des KPI métier concrets. Réduction des coûts, amélioration des délais, augmentation des revenus ou baisse du risque sont les indicateurs clés.

À ces métriques business s’ajoutent des indicateurs opérationnels comme le taux d’adoption, la stabilité des modèles et la réduction du temps de mise en production.

L’industrialisation permet de standardiser les déploiements, d’optimiser les cycles de développement et de sécuriser la création de valeur dans le temps.

Quel rôle jouent la data science et l’automatisation dans des projets ML opérationnels ?

Les data scientists conçoivent et évaluent les modèles, tandis que l’automatisation leur permet de se concentrer sur les cas d’usage à forte valeur ajoutée plutôt que sur des tâches répétitives.

La réussite passe par une collaboration étroite entre data science, ingénierie, sécurité et métiers. C’est cette coordination, soutenue par une gouvernance IA claire, qui permet de transformer un prototype en un système de machine learning réellement utilisé en production.

.svg)