Combiner data science et solution BI est avant tout une question d’usages, pas de technologies. La BI structure, diffuse et fiabilise la lecture du business. La data science, elle, modélise, anticipe et automatise lorsque la décision devient plus complexe, incertaine ou non triviale.

Les deux approches ne s’opposent pas. Elles se complètent — à condition d’être mobilisées au bon moment, avec les bonnes compétences.

Dans la pratique, c’est souvent là que tout se joue. Un cadrage clair permet à la solution BI de répondre efficacement aux besoins de pilotage, pendant que la data science se concentre sur les cas d’usage à forte valeur ajoutée. À l’inverse, quand les rôles sont flous, on empile des outils, on multiplie les initiatives… et la valeur se dilue.

Chez Eulidia, ce constat revient systématiquement : lorsque les usages sont bien définis et les responsabilités clairement assignées, la valeur arrive vite. Sinon, les équipes s’épuisent à maintenir des dispositifs mal alignés avec les attentes métiers.

Comprendre les besoins métiers : BI, reporting, pilotage et prise de décision

Dans une grande entreprise, le besoin n’est pas de “faire de l’IA”. Le besoin est beaucoup plus concret : prendre de meilleures décisions, plus rapidement, et de manière traçable. C’est précisément là que les solutions BI jouent un rôle central. Elles permettent de créer un langage commun, de stabiliser les KPI, de partager des règles de gestion et de proposer des tableaux de bord lisibles, appuyés par un reporting réellement industrialisé.

Sans ce socle, la data science finit souvent cantonnée à des expérimentations isolées, pendant que la BI se transforme en usine à dashboards contradictoires.

Pour éviter cet écueil, le cadrage doit rester simple et pragmatique. Trois questions suffisent souvent à clarifier les attentes : qui consomme l’information, à quel rythme (quotidien, hebdomadaire, temps réel) et pour déclencher quelle action ? Un comité de pilotage n’a ni les mêmes usages ni les mêmes contraintes qu’un manager terrain ou qu’une direction financière. C’est à ce niveau que la BI “fait le job” : visualisation claire, parcours interactifs et indicateurs directement actionnables.

Un autre point, trop souvent sous-estimé, concerne la conformité. Dès que des données personnelles entrent en jeu, la gouvernance et la sécurité ne peuvent plus être traitées comme des sujets annexes. Elles deviennent des exigences de conception, intégrées dès le design des solutions BI et des usages de data science. Les recommandations de la CNIL, notamment sur la sécurité des données personnelles, offrent un cadre opérationnel pour éviter les mauvaises surprises en production, en particulier lorsque les volumes et les usages s’intensifient. Voir le guide sécurité des données personnelles de la CNIL.

Pourquoi BI + Data Science : du descriptif au prédictif, puis à l’automatisation

Les solutions BI excellent pour répondre à deux questions fondamentales : que se passe-t-il et pourquoi. Elles permettent d’analyser les tendances, d’identifier les écarts et de poser un diagnostic partagé.

La data science devient réellement créatrice de valeur lorsque la question évolue : que va-t-il se passer ou que doit-on faire maintenant. On entre alors dans le prédictif, la recommandation, la détection d’anomalies, le scoring ou l’optimisation, avec parfois du machine learning en boucle courte pour ajuster l’action en continu.

Dans la pratique, la combinaison BI et data science fonctionne lorsqu’on enchaîne les bons étages, dans le bon ordre. D’abord fiabiliser les données et les métriques. Ensuite exposer une lecture métier claire via la BI. Puis introduire des modèles pour mieux arbitrer. Et enfin revenir dans un tableau de bord avec une action explicite, compréhensible et traçable.

C’est précisément cette trajectoire que l’on structure dans une démarche de stratégie data : partir des cas d’usage, puis bâtir la gouvernance et la feuille de route qui permettent de passer à l’échelle.

Attention toutefois à un piège fréquent : croire que l’intelligence artificielle remplace la BI. Ce n’est pas le cas. Elle l’augmente, à condition de disposer d’une qualité de données suffisante, d’un modèle sémantique clair et d’une capacité réelle à industrialiser les usages. Sur ces sujets, des cadres comme le NIST AI Risk Management Framework apportent des repères concrets pour garder une approche pragmatique, notamment sur la fiabilité, la sécurité et la gouvernance des systèmes.

Comment cadrer un projet BI / Data Science pour le réussir

Un projet qui fonctionne commence rarement par un outil. Il commence par une décision à améliorer : réduire le churn, mieux planifier la production, limiter la fraude, optimiser les stocks ou piloter la marge. Ce n’est qu’ensuite que se posent les questions de solutions BI, d’architecture et, si nécessaire, de data science. Sources de données, transformations, stockage, exposition BI, puis éventuellement couche analytique ou prédictive : l’ordre compte.

Dans les grandes organisations, un cadrage efficace repose souvent sur une approche en deux temps. D’abord, des quick wins BI pour créer rapidement de la valeur : un tableau de bord réellement utile, un reporting fiable, des métriques partagées. Ensuite, des chantiers plus structurants autour des référentiels, de la gouvernance et de l’industrialisation. Cette trajectoire protège les équipes. Elle permet d’avancer vite sans fragiliser le socle, tout en évitant la fausse bonne idée du “POC éternel”.

Pour rester pragmatique, une check-list simple suffit souvent à poser les bases d’un projet BI et data science solide :

- Clarifier la décision à améliorer et le niveau d’autonomie attendu côté métier

- Identifier les utilisateurs clés et leurs irritants réels (temps, confiance, frictions)

- Cartographier les données disponibles, les zones d’ombre et les données critiques

- Définir une métrique de succès explicite : time to insight, adoption, qualité, impact financier

- Décider si le besoin relève du descriptif (solutions BI) ou de l’analytique et du prédictif (data science)

- Poser une méthodologie d’itération claire et un mode de gouvernance des KPI

Ce type de cadrage n’a rien de théorique. Il permet d’aligner rapidement les équipes, de prioriser les bons usages et de construire des projets BI et data science qui tiennent dans la durée, sans complexifier inutilement les choix techniques.

Compétences indispensables : qui fait quoi entre BI, data science et plateforme

La question des compétences revient systématiquement. Et pour cause : il ne s’agit pas tant d’un organigramme que d’un assemblage de responsabilités bien définies.

Une solution BI a besoin de profils capables de modéliser les données, de sécuriser les règles de gestion, de documenter les indicateurs et de produire une lecture fiable du business.

Une équipe de data science, de son côté, doit savoir expérimenter, valider des hypothèses, puis industrialiser. Sans cette dernière étape, les modèles restent des démonstrateurs… rarement des leviers opérationnels.

Sur le terrain, la différence se joue souvent ailleurs. La delivery BI et data science repose aussi sur l’agilité des équipes, la co-définition des indicateurs avec les métiers et l’amélioration continue après la mise en production. Chez Eulidia, cette logique est centrale : développer la BI self-service, renforcer la qualité des données et faire évoluer les pratiques managériales font partie intégrante de l’approche Delivery Data et BI.

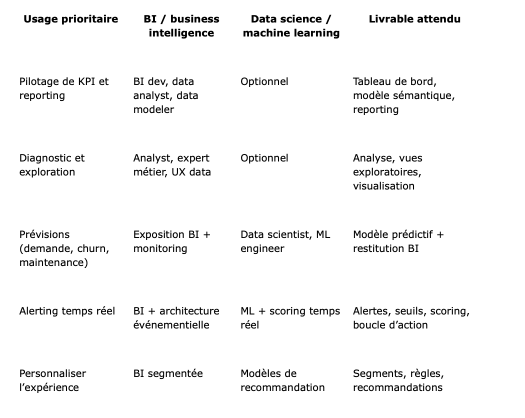

Tableau de correspondance : usages, compétences et livrables

Qualité des données et gouvernance : la partie “pas glamour”, mais décisive

Avant d’analyser finement les données, encore faut-il qu’elles soient utilisables. Définitions stables, référentiels partagés, traçabilité, droits d’accès et contrôles font partie du socle.

La norme ISO/IEC 25012 fournit un cadre utile pour formaliser ce que recouvre réellement la qualité des données : exactitude, complétude, cohérence ou encore crédibilité.

Côté réglementation européenne, certains usages peuvent également entrer dans le champ du AI Act. Selon le niveau de risque, cela implique un renforcement de la documentation, de la gouvernance et des contrôles. Le texte officiel est disponible sur EUR-Lex, et mérite d’être intégré dès la phase de cadrage, pas en fin de projet.

Outils et plateforme : choisir le logiciel, mais surtout l’architecture

Le débat “outil A contre outil B” arrive souvent très tôt. Pourtant, l’essentiel se joue ailleurs. Plateforme de données, modèle sémantique, règles de sécurité et capacité à maîtriser les coûts cloud ont bien plus d’impact à long terme que le choix d’un outil isolé.

Chez Eulidia, l’approche est assumée : une trajectoire cloud centric, une posture technologique agnostique et une conviction forte. Une plateforme moderne doit être simple à l’usage pour les métiers, tout en restant robuste sur la sécurité, la qualité et la gouvernance. C’est cette combinaison qui permet aux solutions BI et à la data science de produire de la valeur, durablement. Pour creuser : Technologies & architectures chez Eulidia.

Choisir une solution BI adaptée : volumétrie, self service, sécurité et coût

Une solution BI n’est jamais “la meilleure” dans l’absolu. Elle est pertinente dans un contexte donné : volumétrie des données, exigences de conformité, profils utilisateurs, maturité data et stratégie analytics globale. C’est précisément cette grille de lecture qui permet d’éviter les choix par effet de mode.

Dans notre comparatif terrain — Sigma, Qlik, Metabase, Tableau, Power BI — chaque outil présente des forces… et des angles morts. Tout dépend des usages réels et de la capacité de l’organisation à les exploiter durablement. Pour approfondir : Choisir une solution BI : comparatif (Sigma, Qlik, Metabase, Tableau, Power BI).

Dans les grands environnements, la décision bascule souvent sur des critères moins visibles, mais décisifs : sécurité, gouvernance et contrôle des accès. Un exemple concret avec Power BI : la Row Level Security ne s’applique pas de la même manière selon les rôles et les workspaces. Ce n’est pas un détail technique, mais un risque opérationnel réel si le modèle de sécurité est mal compris ou mal configuré. Le sujet est d’ailleurs documenté de façon très explicite par Microsoft : Power BI — rôles et permissions (documentation officielle).

Enfin, il est essentiel de raisonner en coût “réel”, et pas uniquement en licences. Exploitation, montée en charge, run, support, dette technique : ce sont ces éléments qui déterminent le coût de possession dans la durée. Le raisonnement est exactement le même côté data science et IA. La valeur se pilote par cas d’usage, avec des métriques métier claires et une discipline d’optimisation continue. Pour poser les bases : Coût de possession de l’IA.

Déployer et intégrer : implémentation agile, architecture et industrialisation

Une solution BI durable n’est pas un lot livré puis oublié. C’est un produit vivant. On observe les usages, on ajuste les métriques, on améliore l’UX, on sécurise les accès et on documente. Les organisations qui réussissent investissent dans l’industrialisation : monitoring, qualité des données, workflows et gouvernance des évolutions.

C’est ce travail continu qui permet d’accélérer les cycles de décision, sans transformer la stack en mille feuilles illisible.

Dans une démarche de transformation, tout commence par un diagnostic de maturité, puis par la capacité à fédérer les parties prenantes et à intégrer la conduite du changement dès le départ. L’adoption se joue souvent là. Si les métiers ne se sentent pas co-propriétaires des usages, même la meilleure BI reste sous-utilisée. Notre approche est détaillée ici : Transformation data et organisationnelle.

Côté architecture, le mot d’ordre reste l’interopérabilité. Sources hétérogènes, ETL ou ELT, couche sémantique, performances et gouvernance du self-service doivent être pensés ensemble. Les projets big data des années précédentes ont parfois laissé une dette difficile à exploiter. L’enjeu en 2026 n’est plus d’empiler, mais d’optimiser les flux, de réduire les doublons et d’exposer un self-service réellement gouverné, utilisable par les métiers et exploitable à l’échelle.

Combiner BI et IA : organisation, sécurité et valeur mesurable

La bonne question n’est pas “faut-il mettre de l’IA partout ?”. La vraie question est plus opérationnelle : où l’IA améliore réellement une décision, sans complexifier inutilement le run ?

Lorsqu’un modèle apporte un gain clair — prévision, priorisation, détection d’anomalies — il doit s’intégrer dans le quotidien via la BI. Alertes, scores, explications et seuils d’action permettent d’ancrer la valeur dans les usages métiers. Cette approche évite une data science hors sol et crée une boucle d’amélioration continue, lisible et pilotable.

Cette approche suppose aussi une organisation claire et assumée. Data owner, data steward, équipe BI, data engineer, data scientist et sponsor métier ont chacun un rôle distinct. Sans cette répartition des responsabilités, les risques sont connus : modèles non maintenus, tableaux de bord peu fiables ou décisions contestées.

Sur le volet conformité, les exigences doivent être intégrées dès la conception : traçabilité des décisions, minimisation des données, contrôle des risques. Les lignes directrices publiées par l’EDPB offrent un cadre concret pour aligner les usages BI et IA avec les obligations RGPD. Pour aller plus loin : Recommandations et lignes directrices RGPD (EDPB).

Enfin, pour rester cohérent avec notre topic cluster “AI & Data Trends to Watch in 2026”, ce sujet peut naturellement être relié aux tendances IA et aux arbitrages d’investissement à venir. Une manière utile de replacer les choix BI et IA dans une trajectoire stratégique plus large : Tendances IA 2026.

Conclusion : un duo gagnant, si vous alignez usages, compétences et gouvernance

La BI et la data science ne sont pas concurrentes. Elles jouent des rôles complémentaires. La BI rend la donnée actionnable, partageable et gouvernable. La data science la rend plus intelligente, plus prédictive et, dans certains cas, plus efficace grâce à l’automatisation.

Le véritable facteur de succès n’est pas technologique, mais structurel.

Tout se joue dans l’alignement : des cas d’usage clairement définis, une implémentation pensée comme un produit, une plateforme robuste et des rôles bien répartis entre les équipes. C’est à cette condition que les solutions BI et la data science cessent d’être des initiatives parallèles pour devenir un levier cohérent de pilotage.

À ce prix-là, vous n’empilez pas des outils. Vous pilotez réellement la performance à partir de vos données, vous savez où concentrer les efforts et où optimiser. Et surtout, vous avancez sans perdre le business en route.

FAQs

Qu’est-ce qu’une solution de business intelligence et comment aide-t-elle à analyser les données ?

Une solution de business intelligence permet de transformer des données brutes en informations exploitables pour le pilotage et la prise de décision. Elle couvre l’analyse de données historiques ou quasi temps réel, la création de tableaux de bord interactifs et la diffusion d’indicateurs partagés.

Les solutions BI s’appuient sur des capacités de data analytics, de data visualisation et de gouvernance pour offrir une lecture fiable du business et aligner les équipes autour de KPI communs.

Comment l’IA et le deep learning complètent-ils la BI ?

L’intelligence artificielle, y compris le deep learning, enrichit la BI lorsque l’analyse descriptive ne suffit plus. Elle permet de détecter des patterns complexes, d’anticiper des comportements et d’automatiser certaines décisions.

Combinées à la BI, ces approches rendent les analyses plus actionnables : scores, alertes, recommandations ou priorisations sont directement intégrés dans les usages quotidiens. La data science intervient alors pour concevoir, tester et fiabiliser ces modèles.

Quelles différences et quel rôle pour les data scientists ?

L’analytics regroupe l’ensemble des approches d’analyse, tandis que la data science se concentre sur la modélisation avancée, le prédictif et l’optimisation.

Le data scientist conçoit des modèles, prépare et transforme les données, puis collabore avec les métiers et les équipes BI pour rendre les résultats compréhensibles et exploitables. L’enjeu n’est pas seulement l’algorithme, mais sa capacité à être intégré dans les décisions opérationnelles.

Quelles sont les grandes tendances du marché BI et analytics ?

Le marché évolue autour de plusieurs dynamiques fortes : généralisation des solutions BI cloud, intégration croissante de l’IA, essor du self service analytique et renforcement de la gouvernance des données.

Ces tendances traduisent un même objectif : permettre aux décideurs d’accéder plus rapidement à des informations fiables, tout en maîtrisant les enjeux de sécurité, de qualité et de conformité.

Quelle méthodologie suivre pour réussir un projet BI ?

Un projet BI efficace repose sur une méthodologie structurée. Il commence par la définition claire des décisions à améliorer, puis par la préparation des données, la modélisation, la validation avec les métiers et le déploiement.

La réussite dépend autant de la qualité du cadrage que de la gouvernance mise en place. Les équipes BI et data science travaillent ensemble pour garantir la fiabilité des données et l’adoption des tableaux de bord.

Quels critères retenir pour choisir une solution de business intelligence ?

Le choix d’une solution BI dépend du contexte : volumétrie des données, intégration avec les sources existantes, capacités de data visualisation, sécurité, conformité et coût global.

Des outils comme Power BI, Tableau ou Qlik doivent être évalués non seulement sur leurs fonctionnalités, mais aussi sur leur capacité à s’inscrire durablement dans l’architecture et les usages de l’entreprise.

Quelle valeur ajoutée pour le pilotage de la performance ?

La combinaison des solutions BI et de l’IA apporte une valeur directe au pilotage de la performance. Elle permet d’identifier les écarts, de détecter les anomalies, d’anticiper les tendances et d’aligner les décisions sur les objectifs métiers.

Les décideurs disposent ainsi d’une vision plus claire, plus réactive et mieux outillée pour arbitrer.

Comment démontrer le retour sur investissement d’une solution BI ?

Le ROI d’une solution BI se mesure à travers des indicateurs concrets : gain de temps dans l’analyse, amélioration de la qualité des décisions, réduction des coûts ou impact sur le chiffre d’affaires.

Des KPI d’adoption, des cas d’usage mesurables et des tableaux de bord de suivi permettent de relier l’analyse des données à des résultats opérationnels et stratégiques.

Comment gérer les défis liés aux grands volumes de données et à la gouvernance ?

La montée en volumétrie pose des défis techniques et organisationnels : performances, qualité, sécurité et conformité.

Une gouvernance claire, des processus d’ingestion et de nettoyage maîtrisés, ainsi qu’une architecture scalable sont indispensables pour garantir que les données restent exploitables par les solutions BI et les équipes de data analytics.

Quels outils permettent de créer des tableaux de bord interactifs efficaces ?

Les outils de BI modernes offrent des capacités avancées de visualisation, de partage et d’interactivité. Ils permettent de créer des tableaux de bord adaptés aux besoins des décideurs, des managers et des équipes opérationnelles.

Le bon outil est celui qui s’intègre à votre environnement, respecte vos contraintes de sécurité et facilite réellement la prise de décision, plutôt que d’ajouter une couche de complexité.

.svg)